논문 : https://arxiv.org/pdf/2509.06942

huggingface : https://huggingface.co/tencent/SRPO

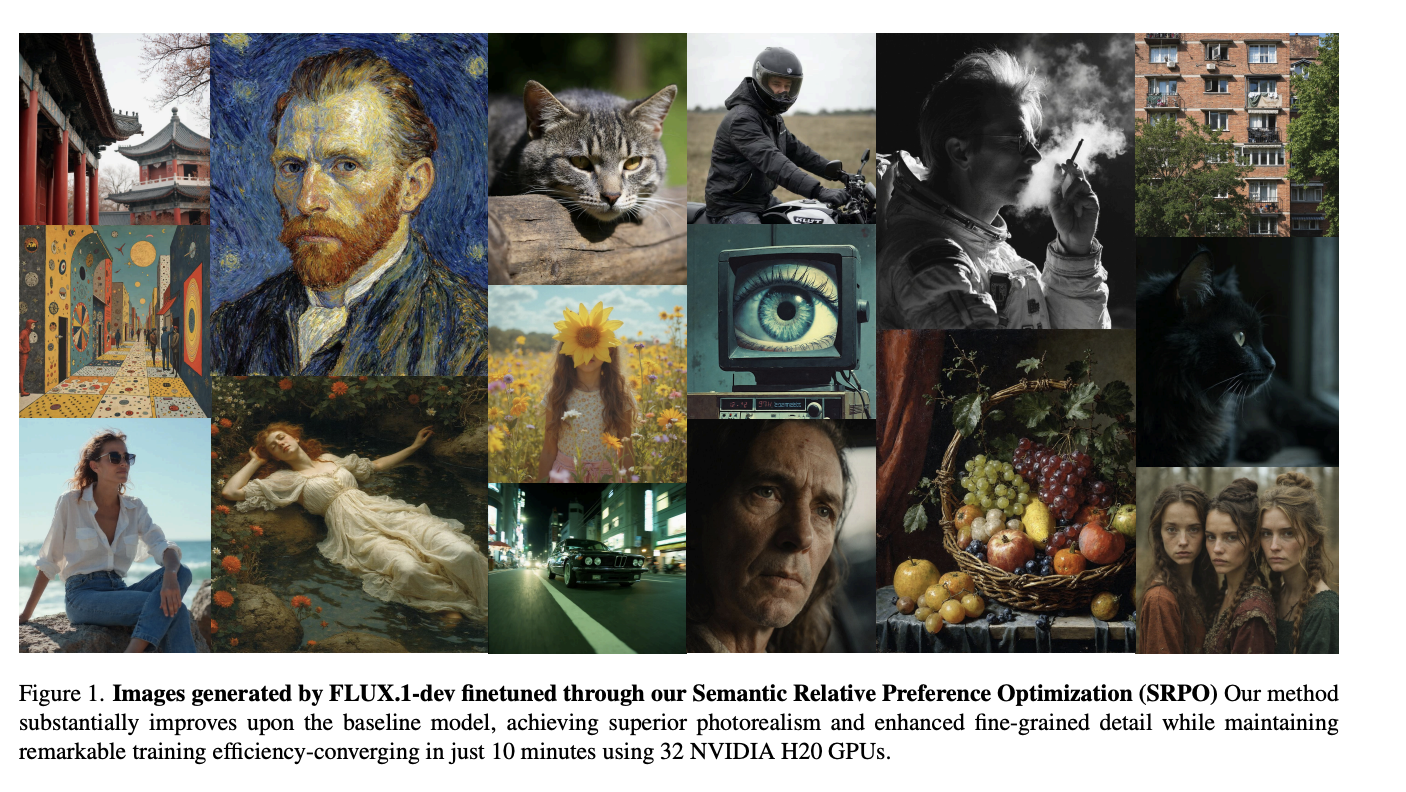

최근 arXiv에 공개된 「Directly Aligning the Full Diffusion Trajectory with Fine-Grained Human Preference」 논문은, 확산 모델(Diffusion Model)을 인간의 선호도에 정렬(alignment)하는 연구 분야에서 매우 인상적인 접근을 제시하고 있다고 생각합니다. 해당 연구는 기존 방법들이 오랫동안 안고 있던 계산 비용 문제와 보상 모델의 경직성 문제를 동시에 해결하면서, 이미지 생성 품질과 학습 효율성 모두에서 의미 있는 도약을 보여주고 있습니다.

특히 FLUX 계열 모델을 기준으로 사실성은 약 3.7배 향상, 훈련 속도는 최대 75배 개선되었다는 실험 결과는 단순한 점진적 개선을 넘어, 확산 모델 정렬 방식 자체에 대한 관점을 바꾸는 계기가 될 수 있다고 판단됩니다.

1. Diffusion 모델 정렬이 직면해 온 핵심 문제

Diffusion 모델을 인간의 선호도에 맞춘다는 것은, 생성된 이미지가 사람이 기대하는 사실성, 미적 완성도, 스타일 일관성을 갖도록 조정하는 과정이라고 볼 수 있습니다. 그러나 기존 접근 방식에는 두 가지 구조적인 한계가 존재했습니다.

첫째는 과도한 계산 비용입니다.

DDPO, DRaFT와 같은 기존의 온라인 강화학습 기반 방법들은 보상 신호를 계산하기 위해 멀티스텝 디노이징 과정 전반에 걸친 그래디언트 계산을 요구합니다. 이로 인해 연산량이 급격히 증가하며, 실제로는 확산 과정의 마지막 4~8개 타임스텝에만 최적화가 집중되는 ‘late timestep bias’ 문제가 발생해 왔습니다.

둘째는 보상 모델의 경직성입니다.

사실성, 조명, 색감과 같은 특정 품질을 조정하려면 보상 모델 자체를 오프라인에서 다시 학습해야 했고, 이는 시간과 자원 측면에서 상당한 부담으로 작용했습니다. 결과적으로 사용자 요구가 빠르게 변하는 실제 서비스 환경에 유연하게 대응하기 어려운 구조였습니다.

2. Direct-Align: 계산 구조 자체를 바꾼 수학적 통찰

이 논문의 첫 번째 핵심 기여는 Direct-Align이라는 접근 방식입니다. 이는 확산 모델의 수학적 특성, 즉 확산 상태가 원본 이미지와 노이즈의 선형 보간(interpolation)이라는 점에 주목한 데서 출발합니다.

확산 모델에서 특정 타임스텝 tt의 상태는 다음과 같이 표현됩니다.

x_t = √α_t · x_0 + √(1-α_t) · ε

여기서 연구진은 모델이 예측한 노이즈 대신, 사전에 정의된 실제 노이즈(ground-truth noise)를 사용함으로써, 멀티스텝 디노이징을 거치지 않고도 단일 단계에서 원본 이미지를 복원할 수 있다는 점을 활용합니다.

이로 인해 Direct-Align은 다음과 같은 간결한 4단계 파이프라인으로 구성됩니다.

- 이미지 생성 또는 로드

- 특정 타임스텝에서 노이즈 주입

- 단일 단계 디노이징 또는 역변환

- 실제 노이즈를 활용한 이미지 복구

이 방식의 가장 큰 의의는, 확산 과정 전체 타임스텝에 대해 균등한 최적화가 가능해졌다는 점입니다. 기존 방법들이 계산 제약으로 인해 후반부 타임스텝에만 집중했다면, Direct-Align은 초기 단계에서도 구조적 정보를 효과적으로 학습할 수 있음을 실험적으로 보여줍니다.

3. SRPO: 의미론적 상대 선호 기반의 온라인 보상 최적화

두 번째 핵심 기여는 Semantic Relative Preference Optimization(SRPO)입니다. SRPO는 텍스트 조건부 보상 신호를 활용하여 보상 모델을 온라인으로 조정할 수 있도록 설계되었습니다.

3.1 Semantic Guided Preference (SGP)

SGP는 보상 함수를 이미지와 텍스트 임베딩의 상호작용으로 정의하며,

“realism”, “brightness”, “contrast”와 같은 **제어 단어(control words)**를 통해 선호 방향을 조절합니다. 이를 통해 추가적인 오프라인 재학습 없이도 보상 기준을 유연하게 변경할 수 있습니다.

3.2 Semantic-Relative Preference (SRP)

SRP는 하나의 이미지에 대해 상반된 의미를 가진 프롬프트 쌍을 동시에 적용하여, 절대적 점수 대신 상대적 선호를 학습합니다. 예를 들어 “high quality, photorealistic”과 “low quality, unrealistic”을 동시에 사용함으로써, 보상 모델의 고정된 편향을 효과적으로 상쇄할 수 있습니다.

이 접근은 기존의 보상 해킹(reward hacking) 문제를 완화하면서도, 세밀한 품질 제어를 가능하게 합니다.

4. 실험 결과와 성능 분석

HPDv2 벤치마크 기반 인간 평가 결과는 매우 인상적입니다.

- 사실성 “Excellent” 평가 비율: 8.2% → 38.9% (약 3.7배 증가)

- 미적 품질: FLUX.1.dev 대비 3.1배 개선

- 전반적 선호도: 모든 항목에서 일관된 향상

또한 자동 평가 지표(Aesthetic Score v2.5, PickScore, ImageReward, HPSv2.1) 전반에서도 우수한 성능을 보였으며, 보상 점수 인플레이션의 징후는 관측되지 않았습니다.

훈련 효율성 측면에서도,

- 32대 NVIDIA H20 GPU 환경에서 약 10분 내 수렴

- 기존 DanceGRPO 대비 약 75배 빠른 학습 속도

- 1,500장 미만의 소규모 데이터셋으로도 효과적인 학습 가능

이라는 결과는, 상용 환경에서의 적용 가능성을 크게 높여줍니다.

5. 기술적 강점과 한계에 대한 균형 잡힌 시각

이 연구의 강점은 수학적으로 엄밀하면서도 실용적인 접근을 통해, 효율성과 유연성을 동시에 확보했다는 점입니다. 특히 온라인 보상 조정 가능성은 실제 서비스 환경에서 매우 중요한 장점입니다.

다만 몇 가지 한계도 존재합니다.

- 인간 평가의 일반화 가능성

- FLUX 계열 외 아키텍처(U-Net, 다른 DiT 계열)에서의 검증 부족

- 장기적인 온라인 보상 조정의 안정성 및 악의적 프롬프트에 대한 내성

이러한 부분은 후속 연구를 통해 보완되어야 할 과제로 보입니다.

6. AI 안전성과 거버넌스 관점에서의 시사점

계산 효율성의 비약적 개선은 고품질 정렬 기법의 민주화라는 긍정적 효과를 가져올 수 있습니다. 동시에, 텍스트 기반 선호 조정의 유연성은 악용 가능성과 규제 복잡성이라는 새로운 과제를 동반합니다.

따라서 산업 차원에서는,

- 책임 있는 정렬 모델 배포를 위한 모범 사례 수립

- 장기적 정렬 안정성과 안전성에 대한 연구 강화

- 문화적 다양성을 고려한 국제적 협력

이 함께 논의되어야 할 시점이라고 생각합니다.

맺음말

이번 논문은 확산 모델 정렬 분야에서 계산 구조, 최적화 범위, 보상 설계 방식을 동시에 재정의한 연구라고 평가할 수 있습니다.

사실성 3.7배 향상과 75배의 학습 효율 개선은 단순한 수치 이상의 의미를 가지며, 확산 모델이 실제 상용 환경으로 더 빠르게 진입할 수 있는 기반을 마련했다고 생각합니다.

동시에, 이러한 기술적 진보가 장기적으로 안전하고 인간 중심적인 AI 시스템으로 이어지기 위해서는, 기술적·사회적 논의가 함께 발전해야 할 것입니다.

확산 모델 정렬 분야는 분명 새로운 전환점에 서 있으며, 앞으로의 연구와 적용 사례가 매우 기대됩니다.